Inloggen

Bouw uw site

Is Herhaalde Informatie op een Website Slecht voor SEO? Volledig Uitleg

Hoewel sommige herhalingen acceptabel kunnen zijn. Echter, te veel herhaling kan schadelijk zijn voor SEO door de gebruikerservaring, de crawl-efficiëntie en de inhoudskwaliteit te beïnvloeden.

Binnen een bibliotheek zijn boeken netjes georganiseerd per onderwerp, auteur en publicatiejaar. Maar er is een probleem.

Veel van hen hebben precies dezelfde inhoud, en sommige hebben zelfs dezelfde titel maar verschillende omslagen. Je kunt verward raken: welk boek moet ik kiezen? Welk boek is het meest autoritatief en waardevol? Deze verwarring is ook een probleem dat zoekmachines tegenkomen bij het omgaan met herhaalde informatie.

Herhaalde inhoud of herhaalde informatie is een veelbesproken onderwerp in SEO. Maar er kunnen soms misverstanden over bestaan. In het artikel zullen we dit probleem vooral bespreken en ook alle problemen beschrijven die moeten worden overwogen bij het aanpakken van herhaalde inhoud.

Begrip van herhaalde inhoud

Kort gezegd is herhaalde inhoud hetzelfde tekst, afbeelding of code binnen dezelfde website of over meerdere websites. Het verwijst ook naar herhaalde inhoud die gedeeltelijk hetzelfde is, maar een kleine verschil heeft in de vorm van uitdrukking.

De criteria voor het bepalen van herhaalde inhoud worden meestal bepaald door de algoritmes van zoekmachines, die de tekst, structuur en code van een webpagina in verschillende dimensies kunnen analyseren om de herhaling van inhoud te bepalen.

-

Tekstgelijkheid en inhoudsformaat

-

Unieke waarde van inhoud

-

Paginabouw en code

-

URL herhaling

-

Gelijke meta tags en titels

-

Vertaalde taalversies

Dus is herhaalde informatie op een website slecht voor SEO?

Hier is een cognitieve misvatting: de SEO van een website wordt niet erger door enige herhaalde informatie.

In werkelijkheid is de reden hiervoor een aantal factoren. Dit komt omdat Google een aantal factoren overweegt bij het crawlen, indexeren en rangschikken van pagina's.

Daarom gaan we dieper in op hoe herhaalde inhoud SEO beïnvloedt.

Hoe herhaalde inhoud SEO beïnvloedt?

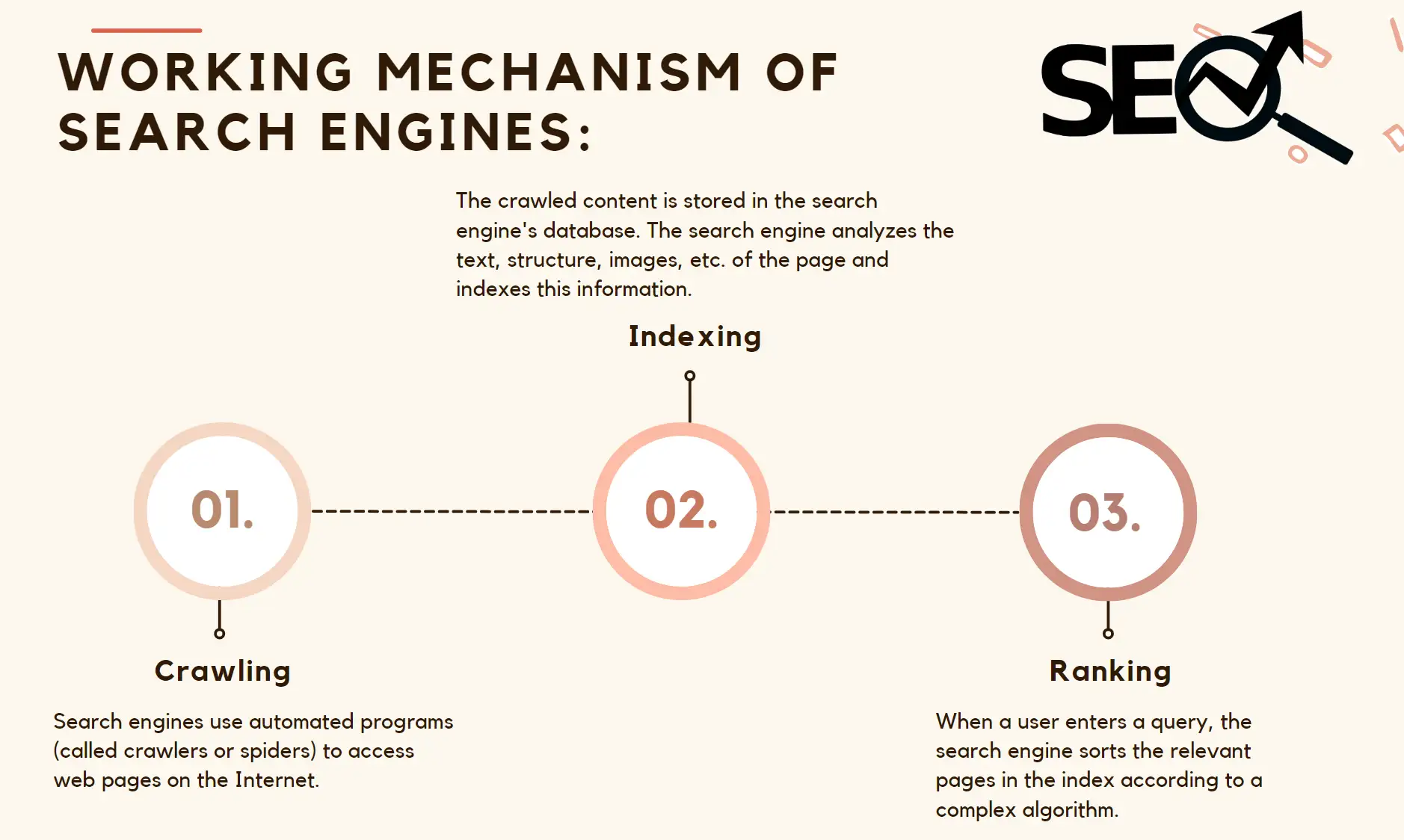

Om het effect van herhaalde inhoud op SEO te herkennen, moeten we eerst teruggaan naar het oorspronkelijke uitgangspunt van het werkingmechanisme van zoekmachines om te begrijpen hoe zoekmachines inhoud crawlen.

werkingmechanisme van zoekmachines:

Verzwakte Pagina Autoriteit

Pagina Autoriteit of Page Rank is een indicator die zoekmachines gebruiken om de autoriteit en relevantie van een webpagina voor een bepaald onderwerp of zoekwoord te meten. Het concept werd voor het eerst ingevoerd door Google om te bepalen welke pagina's hoger moeten worden gerangschikt in zoekresultaten.

Als meerdere pagina's herhaalde inhoud bevatten, kunnen zoekmachines niet nauwkeurig bepalen welke pagina meer gewicht moet krijgen en zullen ze uiteindelijk de pagina slecht laten presteren op zoekmachinestrips.

Enkele van de belangrijkste redenen voor herhaalde inhoud in termen van autoriteit:

-

Meerdere URLs die naar dezelfde inhoud wijzen

-

Herhaalde of vergelijkbare inhoudspagina's

-

Externe Link Toewijzing

-

Interne Link Structuur

Als dezelfde inhoud onder verschillende URLs bestaat (bijvoorbeeld meerdere pagina's gegenereerd via categorieën, tags, parameterized URLs, etc.), zullen zoekmachines deze URLs als verschillende pagina's behandelen. Hoewel de inhoud hetzelfde is, wordt het gewicht verspreid over deze pagina's, wat ervoor zorgt dat geen enkele individuele pagina het SEO-gewicht krijgt dat het verdient.

Over het algemeen is het kernprobleem van gedecentraliseerd gewicht dat zoekmachinealgoritmes niet kunnen bepalen wie de optimale pagina is, dus als er herhaalde of vergelijkbare inhoud op een pagina is, trekken meerdere pagina's elkaar in termen van gewichtsverdeling naar beneden, waardoor de totale SEO-prestatie van alle pagina's verzwakt wordt.

Indexatieproblemen

We hebben al uitgebreid beschreven in het vorige artikel dat, nadat een webpagina is gecrawled, zoekmachines de inhoud van de pagina analyseren en opslaan in een grote database. Dit proces wordt indexatie genoemd en een pagina kan alleen worden weergegeven in zoekresultaten nadat het is geïndexeerd. Als een pagina de indexatiestap niet doorloopt, betekent dit dat het niet wordt weergegeven voor de gebruiker, zelfs als het bestaat.

Bij het crawlen moeten we weten dat er iets bestaat wat "crawl budget" wordt genoemd, wat betekent dat zoekmachine crawlers een beperkt aantal pagina's per dag op een website kunnen crawlen. Wanneer pagina's op een website met herhaalde inhoud worden gecrawled, zal de crawler tijd en bronnen besteden aan het crawlen van deze vergelijkbare pagina's, wat het crawl budget verspilt dat moet worden toegekend aan hoogwaardige, unieke inhoud.

Negatieve gebruikerservaring

Voor gebruikers is het klikken op meerdere pagina's maar het zien van bijna dezelfde inhoud zoals het kijken naar een film met dezelfde scène steeds opnieuw.

Herhaalde inhoud moet een negatieve rol gespeeld hebben in de tevredenheid van websitegebruikers. Denk eraan dat je steeds hetzelfde inhoud leest; gebruikers zullen onophoudelijk zo'n oninteressante website verlaten, wat leidt tot een hogere bounce rate en kortere verblijftijd op de website.

Google's beleidsverklaring over herhaalde inhoud

Google zegt dat duplicate content een website niet zal bestraffen. Dit komt omdat het belangrijkste doel van de zoekmachine is om gebruikers de meest relevante en nuttige resultaten te geven van hun zoekopdrachten. Daarom beïnvloedt duplicate content niet direct de rangschikking, maar kan duplicate content wel beïnvloeden hoe content wordt weergegeven en geïndexeerd. Om de SEO-prestaties van een website te optimaliseren, moeten websitebeheerders zich richten op de uniekheid van hun content, zorgvuldig gebruik maken van canonical tags en omleidingen, en zich houden aan de beste praktijken van zoekmachines om de kwaliteit van de content en de gebruikerservaring van hun website te waarborgen.

Hoe te voorkomen dat er duplicate content ontstaat?

Originele content maken

Gebruikers houden van creatieve en waardevolle dingen, en Google volgt deze voorkeur. We schrijven onze websitecontent rondom trefwoorden, ook wel gebruikerszoekwoorden genoemd. We moeten inbrengen wat de echte behoeften van de doelgroep zijn. Wat zijn hun pijnpunten? Dit is de prioriteit bij het schrijven van originele content.

Zorg er dan voor dat de content van hoge kwaliteit en origineel is, alleen content die echt leesbaar en inzichtelijk is. Dit zijn de eisen voor het schrijven van betrokken content.

Canonical tags gebruiken

Omdat er veel content op de pagina's van een website is, is het onvermijdelijk dat er soms enkele herhaalde thema's zijn, vooral op blogpagina's. Als je vergelijkbare of herhaalde pagina's hebt, dan zijn canonical tags nodig om de zoekmachines te vertellen welke versie van de pagina de hoofdversie is; gebruik canonical tags op alle varianten om te verwijzen naar de hoofdversie. Hiermee wordt de pagina autoriteit geconsolideerd.

301 omleidingen gebruiken

301 omleiding is vaak gebruikt door websites als maatregel om duplicate content te voorkomen. 301 is een vorm van permanente omleiding. 301 omleiding is een HTTP-statuscode die gebruikt wordt om zoekmachines en gebruikers te vertellen dat wanneer ze een bepaalde pagina bezoeken, de server ze automatisch naar een nieuwe pagina zal omleiden.

Als een pagina of URL is veranderd, zorgt een 301 omleiding ervoor dat gebruikers automatisch naar de juiste pagina worden doorgestuurd zonder een 404 foutpagina tegen te komen, op een manier die zowel de gebruikerservaring behoudt, als ook de SEO-waarde van de oude pagina naar de nieuwe pagina overdraagt.

Je content monitoren

Onthoud dat SEO niet alleen een kwestie is van streven naar perfectie, maar een proces van constante optimalisatie. Het is een goede gewoonte om de functionaliteit en prestaties van je website regelmatig te testen.

Niet alleen kun je zo controleren op duplicate content, maar ook op een aantal andere problemen die gerelateerd zijn aan siteprestaties en gebruikerservaring.

Hoe controleer je op duplicate content?

Daarom kunnen we zien dat het vinden van duplicate content cruciaal is om je website origineel en SEO-geoptimaliseerd te houden. We moeten weten wat duplicate content is, wat een belangrijke taak is voor zowel websitebeheerders als SEO-optimalisatoren.

1. Handmatige controle

De eenvoudigste en directste manier is om de inhoud van het artikel direct in de zoekbalk van Google te kopiëren en te plakken en het tussen aanhalingstekens te brengen. Dit zal ervoor zorgen dat de zoekmachine laat zien of hetzelfde tekst op andere pagina's voorkomt. De resultatenpagina geeft ook duplicaten in het rood aan; dit zijn inhoudsproblemen die moeten worden aangepast.

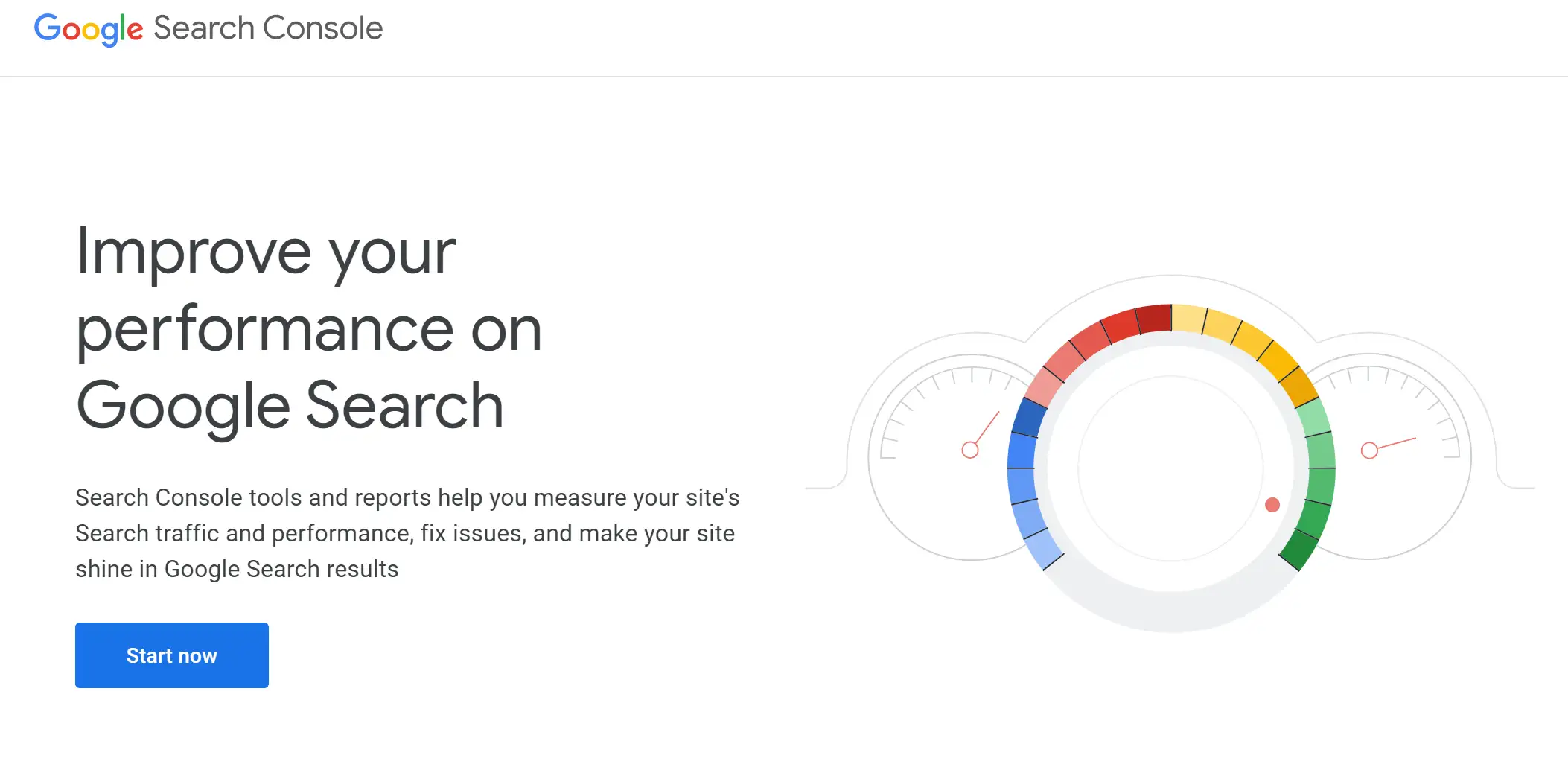

Google Search Console

Google heeft Google Search Console ontwikkeld om rapportage te geven over problemen met duplicate content, vooral om te zoeken naar fouten met "duplicate zonder gebruikersselectie" om problematische pagina's te identificeren, en om te begrijpen welke URLs al door Google zijn geïndexeerd.

3. Online tools gebruiken

Er zijn ook veel online tools beschikbaar op het web om je te helpen bij het identificeren van duplicate content op en off je website:

-

Siteliner: Deze tool werkt door je website volledig te scannen op pagina's met duplicate content op je website en laat ook zien hoeveel en welk percentage van de woorden duplicaat is.

-

Screaming Frog SEO Spider: Deze tool kan gebruikt worden om kleine en grote websites te crawlen om duplicate content problemen op te sporen op basis van de titel, meta beschrijving en inhoud van je pagina.

4. Plagiarisme detectie software

Er zijn ook enkele online software beschikbaar, zoals plagiaatdetectors, die je kunnen helpen bij het vinden van duplicate of vergelijkbare content op alles op het web.

-

Grammarly: Grammarly helpt ons niet alleen bij het corrigeren van grammaticaproblemen in onze artikelen, maar biedt ook een plagiaatcontrolefunctie die je artikel vergelijkt met een grote database op het web en identificeert duplicate content in het artikel.

-

Scribber: Scribber kan controleren waar de originele tekst is geplagieerd en de vergelijkbaarheid tussen jouw eigen tekst en jouw eigen inhoud met lagere duplicaatwaarden vergelijken.

5. Content Management Systeem

Een content management systeem is een tool die geïntegreerde functionaliteit, plugins of tools van derden gebruikt om duplicate content op verschillende manieren te detecteren en te beheren.

Conclusie

Om er voor te zorgen dat bibliothecarissen snel de meest waardevolle boeken kunnen aanraden, moeten bibliotheken ervoor zorgen dat de inhoud van elk boek uniek en origineel is. Op dezelfde manier moet SEO ervoor zorgen dat informatie niet wordt gedupliceerd en dat elke pagina een unieke waarde heeft, zodat zoekmachines je site-inhoud efficiënt kunnen crawlen en tonen.

Je website kan alleen op lange termijn een sterke en overtuigende digitale aanwezigheid opbouwen door hoogwaardige, gebruikerswaarde biedende inhoud te leveren. Toch hoeven we niet per se bang te zijn voor gedupliceerde inhoud. Alleen door de geest van de inhoud te behouden, waarbij de gebruiker voorop staat, zal de inhoud van je website echte waarde aan de gebruiker overbrengen, wat de beste praktijk van SEO is. Zelfs als we gedupliceerde website-inhoud tegenkomen, kunnen we de juiste tools en strategieën gebruiken om het risico te beperken.

Wil je meer informatie over SEO? Lees verder op Wegic Blog.

Aanvullende leesstof

Geschreven door

Kimmy

Gepubliceerd op

12 apr 2026

Deel artikel

Lees meer

Onze nieuwste blog

Webpagina's binnen een minuut, aangedreven door Wegic!

Met Wegic kun je je behoeften omzetten in prachtige, functionele websites met geavanceerde AI

Gratis proefversie met Wegic, bouw je site in een klik!

Wat voor soort website wil je bouwen?