ログイン

サイトを作成

ウェブサイト上の繰り返し情報はSEOに悪いのか?完全に説明します

一部の重複は許容されるかもしれませんが、過度な繰り返しはユーザー体験、クロール効率、コンテンツ品質のシグナルに悪影響を及ぼす可能性があります。

図書館では、本は主題、著者、出版年で整然と整理されています。しかし、問題があります。

それらの多くは同じ内容を持っており、同じタイトルでも異なる表紙を持つものもあります。あなたは混乱するかもしれません:どの本を選べばよいのでしょうか?どの本が最も権威的で価値があるのでしょうか?この混乱感は、検索エンジンが重複情報に対処する際にも遭遇する問題です。

重複コンテンツや繰り返し情報は、SEOにおいてよく議論されるトピックです。しかし、この点について誤解があることもあります。本文では、この問題について主に取り上げ、重複コンテンツに対処する際に考慮すべきすべての問題についても説明します。

重複コンテンツの理解

簡単に言うと、重複コンテンツとは、同じウェブサイト内または複数のウェブサイト間で同じテキスト、画像、コードを指します。また、表現の形がわずかに異なるものの、部分的に同じ内容のものを指します。

重複コンテンツを判断する基準は、通常、検索エンジンのアルゴリズムによって決定されます。検索エンジンは、ウェブページのテキスト、構造、コードをいくつかの次元で分析し、コンテンツの重複を判断する可能性があります。

-

テキストの類似性とコンテンツのフォーマット

-

コンテンツのユニークな価値

-

ページ構造とコード

-

URLの重複

-

類似したメタタグとタイトル

-

翻訳された言語バージョン

では、ウェブサイトに繰り返し情報があるのはSEOにとって悪いことでしょうか?

ここに認知的な誤解があります:ウェブサイトのSEOは、いくつかの繰り返し情報があることで悪化しないのです。

実際には、その理由はいくつかの要因によるものです。これは、Googleがページのクロール、インデックス作成、ランク付けの際、いくつかの要因を考慮するためです。

したがって、重複コンテンツがSEOに与える影響について詳しく探っていきます。

重複コンテンツがSEOに与える影響

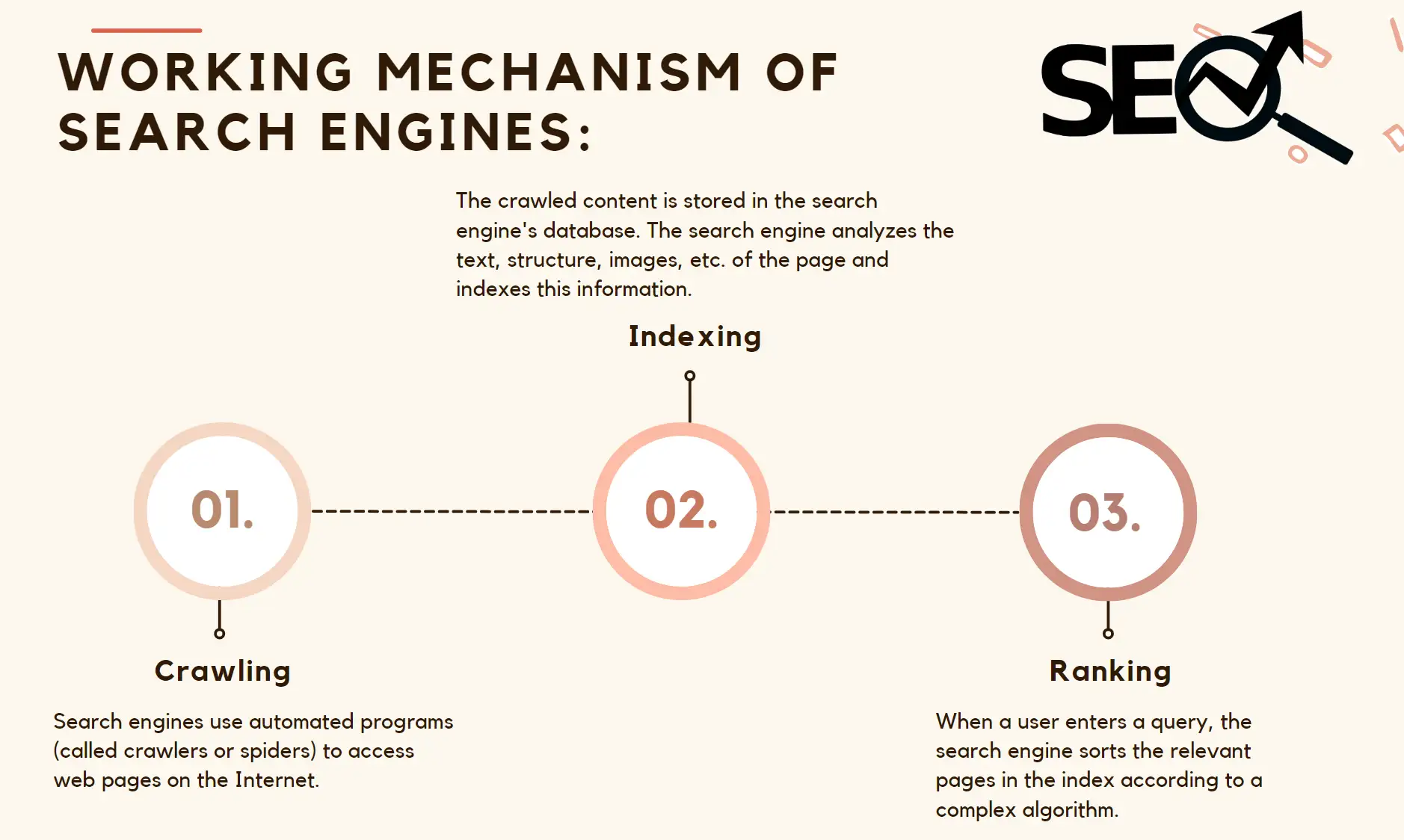

重複コンテンツがSEOに与える影響を認識するには、まず検索エンジンがコンテンツを認識する仕組みの元の出発点に戻る必要があります。

検索エンジンの作業メカニズム:

ページ権限の希薄化

ページ権限またはページランクは、検索エンジンが特定のトピックやキーワードに対するウェブページの権威性と関連性を測定するために使用される指標です。この概念は、Googleによって最初に導入され、検索結果でどのページを上位にランク付けすべきかを決定するために使用されました。

複数のページに重複コンテンツが含まれている場合、検索エンジンはどのページがより重みを受けるべきかを正確に判断できず、最終的に検索エンジンのページでパフォーマンスが悪くなります。

権限の観点から見ると、重複コンテンツの主な理由のいくつかは次の通りです:

-

同じコンテンツに複数のURLが指向している

-

重複または類似したコンテンツのページ

-

外部リンクの割当て

-

内部リンク構造

同じコンテンツが異なるURLで存在する場合(例えば、カテゴリ、タグ、パラメータ付きURLなどによって生成された複数のページ)、検索エンジンはこれらのURLを異なるページとして扱います。コンテンツは同じですが、重みはこれらのページに分散され、個々のページが本来得るべきSEOの重みを集中して得られなくなります。

全体的に見ると、分散された重みの問題の核心は、検索エンジンのアルゴリズムが最適なページを判断できないことです。したがって、ページに重複または類似したコンテンツがある場合、複数のページが重みの配分においてお互いを引き下げるため、すべてのページの全体的なSEOパフォーマンスが弱まります。

インデックス化の問題

以前の記事で詳しく説明したように、検索エンジンはウェブページをクロールした後、ページのコンテンツを分析し、巨大なデータベースに保存します。このプロセスはインデックス化と呼ばれ、ページが検索結果に表示されるにはインデックス化が行われる必要があります。ページがインデックス化の段階を通過できなければ、存在していてもユーザーに表示されません。

クロールする際には、「クロール予算」というものがあることを知っておく必要があります。これは、検索エンジンのクローラーが1日あたりウェブサイトでクロールできるページ数に制限があることを意味します。重複コンテンツを持つウェブサイトのページがクロールされる場合、クローラーはこれらの類似ページをクロールするために時間とリソースを費やし、高価値でユニークなコンテンツに割り当てられるべきクロール予算を浪費することになります。

ネガティブなUX

ユーザーにとって、複数のページをクリックしてほぼ同じコンテンツを見ることとは、同じシーンを繰り返し見る映画を観ているようなものです。

重複コンテンツは、ウェブサイトユーザーの満足度に悪影響を及ぼしている可能性があります。常に同じコンテンツを読むことを想像してみてください。ユーザーは退屈なサイトから次々に離れていくため、サイトのバウンス率が高くなり、ウェブサイトでの滞在時間が短くなります。

Googleの重複コンテンツに関するポリシー文書

Googleは、重複コンテンツがウェブサイトをペナルティするとは言っていません。これは、検索エンジンの主な関心事は、ユーザーに検索結果から最も関連性があり、役立つ結果を提供することであるためです。したがって、重複コンテンツは直接的なランキングに影響を与えませんが、コンテンツの表示やインデックス付けに影響を与える可能性があります。ウェブサイトのSEOパフォーマンスを最適化するためには、ウェブサイトのオーナーはコンテンツの独自性に焦点を当て、キャノニカルタグやリダイレクトを適切に使用し、検索エンジンのベストプラクティスに従って、ウェブサイトのコンテンツの品質とユーザー体験を確保する必要があります。

重複コンテンツを避ける方法

オリジナルコンテンツの作成

ユーザーは創造的で価値のあるもの好きで、Googleもこの好みに従っています。私たちはキーワード、つまりユーザーの検索語を中心にウェブサイトのコンテンツを作成しています。私たちがすべきことは、実際のオーディエンスのニーズを把握することです。彼らの課題は何ですか?これはオリジナルコンテンツを書く際の最優先事項です。

その後、コンテンツが高品質で独自であることを確認してください。本当に読みやすく、洞察に満ちたコンテンツのみを提供する必要があります。これは、魅力的なコンテンツを書くための要件です。

キャノニカルタグの使用

ウェブサイトのページには多くのコンテンツがあるため、いくつかの重複テーマがあるのは避けられないことです。特にブログページでは、類似または重複するページがある場合、検索エンジンにどのバージョンがメインバージョンであるかを伝えるためにキャノニカルタグが必要です。すべてのバリアントにキャノニカルタグを使用してメインバージョンにポイントしてください。これにより、ページの権限が統合されます。

301リダイレクトの使用

301リダイレクトは、重複コンテンツを避けるためにウェブサイトで一般的に使用される手段です。301は永続的なリダイレクトの一種です。301リダイレクトは、ユーザーが特定のページにアクセスしたときに、サーバーが自動的に新しいページにリダイレクトするように検索エンジンとユーザーに伝えるHTTPステータスコードです。

ページまたはURLが変更された場合、301リダイレクトを使用すると、ユーザーが404エラーページに遭遇することなく、正しいページに自動的にリダイレクトされます。これは、ユーザーのブラウジング体験を維持するだけでなく、古いページから新しいページにSEOの重みを移す方法です。

コンテンツのモニタリング

SEOは完璧を目指すだけでなく、継続的な最適化のプロセスであることを覚えておくことが重要です。定期的にウェブサイトの機能とパフォーマンスをテストすることは良い習慣です。

これにより、重複コンテンツだけでなく、サイトのパフォーマンスやユーザー体験に関連する他の問題も確認できます。

重複コンテンツをチェックする方法

したがって、ウェブサイトのオリジナル性とSEOのパフォーマンスを維持するために、重複コンテンツを見つけることは非常に重要です。重複コンテンツとは何かを特定することは、ウェブサイトオーナーとSEO最適化担当者にとって非常に重要なタスクです。

1. 手動チェック

これは最も簡単で直接的な方法です。記事のコンテンツを直接Googleの検索バーにコピー&ペーストし、引用符で囲んで表示します。これにより、検索エンジンはその同じテキストが他のページに表示されているかどうかを示します。結果ページでは、重複コンテンツが赤色で強調表示され、修正が必要なコンテンツの問題です。

Google Search Console

Googleは、重複コンテンツの問題に関するレポートを提供するためにGoogle Search Consoleを開発しました。主に「ユーザーが選択した指定なしの重複」エラーを検出するために使用され、問題のあるページを特定し、Googleがすでにインデックス化しているどのURLかを理解します。

オンラインツールの使用

ウェブ上には、ウェブサイト内外の重複コンテンツを識別するための多くのオンラインツールが利用可能です。

-

Siteliner: このツールは、ウェブサイト全体をスキャンして、ウェブサイト内の重複コンテンツを持つページを検出し、重複する単語の数と割合も表示します。

-

Screaming Frog SEO Spider: このツールは、ページのタイトル、メタディスクリプション、コンテンツに基づいて、小規模および大規模なウェブサイトの重複コンテンツの問題を検出するために使用できます。

4. プラギアリズム検出ソフトウェア

ウェブ全体で重複または類似のコンテンツを見つけるために、いくつかのオンラインソフトウェアも利用可能です。

-

Grammarly: Grammarlyは、記事の文法的な問題を修正するだけでなく、ウェブ上の巨大なデータベースと比較して、記事内の重複コンテンツを特定するプラギアリズムチェック機能も提供します。

-

Scribber: Scribberは、オリジナルテキストが盗作されている場所を確認し、自分のテキストと自分のコンテンツの類似性を比較して、重複値が低いオリジナルコンテンツを作成するのに役立ちます。

5. コンテンツ管理システム

コンテンツ管理システムは、重複コンテンツを検出および管理するための組み込み機能、プラグイン、またはサードパーティツールを統合したツールです。

結論

図書館が迅速に最も価値のある本を推奨できるようにするには、図書館が各本のコンテンツがユニークでオリジナルであることを確認する必要があります。同様に、SEOは情報の重複を避けて、各ページがユニークな価値を持つことを確保する必要があります。これにより、検索エンジンがサイトのコンテンツを効率的にクロールおよび表示できるようになります。

あなたのウェブサイトは、高品質でユーザーに価値のあるコンテンツを提供することによって、時間をかけて強力で説得力のあるデジタルプレゼンスを構築できます。しかし、必ずしも重複コンテンツを恐れる必要はありません。コンテンツの精神を堅持し、ユーザーを最優先にすることによって、あなたのウェブサイトのコンテンツはユーザーに本当の価値を伝えることができ、これはSEOの最良の実践です。たとえ重複するウェブコンテンツに遭遇したとしても、適切なツールと戦略を使用してリスクを最小限に抑えることができます。

SEOに関するさらに詳しい情報が必要ですか?Wegicブログを読んでください。

追加の読み物

著者

Kimmy

投稿日

2026年4月12日

記事を共有

続きを読む

最新のブログ

Wegicで一分でウェブページを!

Wegicを使用して、先進的なAIであなたのニーズを見事で機能的なウェブサイトに変えましょう。

Wegicで無料トライアル、一クリックでサイトを構築!

どのようなウェブサイトを作りたいですか?